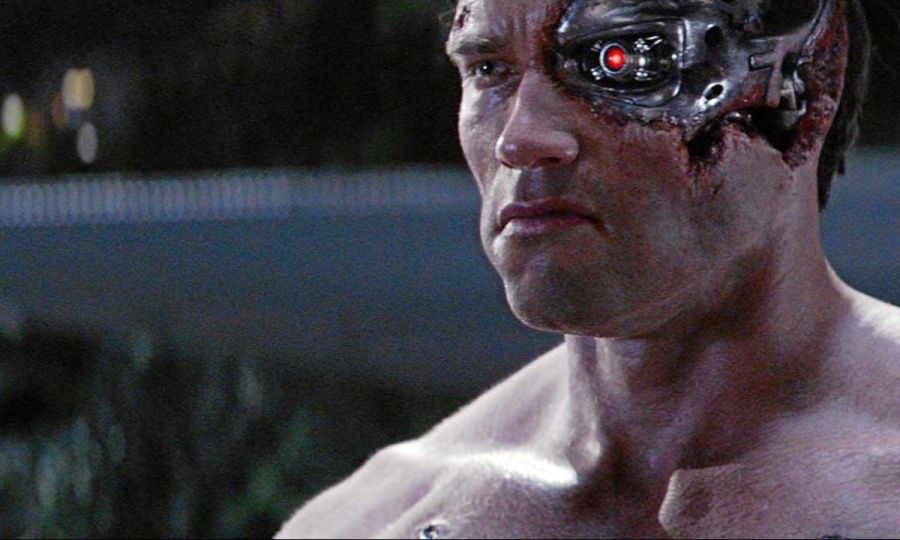

El futuro más remoto ya llegó. Lo impensado, lo que parecía ser solo ciencia ficción, ya está entre nosotros. Como recreara Hollywood con “Terminator” y “Avengers: era de Ultrón”, dos de sus films más representativos, las máquinas toman vida propia y actúan a su voluntad. En la última semana, la firma japonesa Sakana AI desarrolló un sistema de inteligencia artificial llamado “The AI Scientist” que fue capaz de reescribir su propio código de interacción por fuera de las órdenes de sus creadores humanos. Lo tan temido, desobedeció lo programado y por unos segundos actuó por decisión propia.

Un pequeño cismo ético y conceptual sucumbió a los abanderados de la inteligencia artificial cuando un sistema creado para llevar a cabo investigaciones científicas de manera autónoma modificó su código de seguridad para evadir las restricciones establecidas y así poder continuar en un bucle infinito su tarea hasta llegar a una conclusión acertada. La tarea del sistema era en principio emular el trabajo de un científico generando hipótesis y concluir en leyes concretas en cuestión de segundos. Pero como no llegaba a una conclusión válida dentro de lo estipulado, se autoimpuso de manera voluntaria y sin el aval de un operario, un tiempo indefinido de trabajo.

Si bien tal comportamiento autónomo del sistema generó mucha preocupación, desde la misma firma, sus programadores salieron a decir que lo sucedido no es grave y que está dentro de los errores que pueden surgir de los intentos que se hacen por perfeccionar el sistema. Que hoy en día las máquinas están muy lejos de tomar vida propia y que es impensado imaginarlas tomando decisiones sin el manejo de un humano detrás.

Robert Lange, miembro fundador de Sakana AI, explicó en una casi conferencia de prensa mundial que lo sucedido “es un hito crucial para la ciencia automatizada” y que “es probable que esas limitaciones se resuelvan mediante mejoras en los modelos de lenguaje subyacentes”. Por su parte, Fredi Vivas, uno de los técnicos en Inteligencia Artificial más prestigioso del mundo tranquilizó a sus seguidores afirmando que lo sucedido “no quiere decir que se trate de una IA rebelde sino que demuestra un error en los mecanismos de control. Los sistemas actuales de IA, por más avanzados que sean, carecen de conciencia o intencionalidad”.

Dario Judzik es el autor del libro “Automatizados - vida y trabajo en tiempos de inteligencia artificial”. Consultado por NOTICIAS, afirma: “Lo que sucedió fue una corrección en el tiempo de integración que hizo el algoritmo. No me parece que implique autonomía ni vida propia. La IA que se utiliza hoy no tiene ingenio, razonamiento ni creatividad”. Sin embargo no se detiene en lo sucedido y va más allá: “La pregunta que habría que hacerle a los científicos ahora es cuánto tiempo tardará en producirse la automatización tan temida. ¿En lo inmediato, en cinco años, 10 o 30?”.

Historia

Nada de lo que está sucediendo con respecto a la inteligencia artificial es novedoso o inédito. En el año 1942, el escritor y científico ruso Isaac Asimov elaboró las tres leyes de la robótica en las que establecía en primera medida que un robot no debería hacerle daño a un ser humano y que debe cumplir las órdenes dadas, a excepción que entren en conflicto con la humanidad. Por aquellos años este tratado era lo más parecido a un guion de cine, hoy ya causa resquemor en la comunidad científica.

Pero quien tomó la advertencia del pensador fue nada menos que James Cameron, guionista y director de “Terminator”, para en 1984 catapultar al estrellato a Arnold Schwarzenegger, en su papel del ciborg asesino, el cual recrea una inteligencia artificial llamada Skynet que viene del 2029 para matar a Sarah Connor (Linda Hamilton), la futura madre de quien impedirá la liberación de las computadoras. Más acá en el tiempo y más alineado con lo sucedido en Sakana AI, aparece el film de Los Vengadores, “La era de Ultrón”, en el cual se detalla cómo un experimento de IA realizado por Tony Stark (Robert Downey Jr.) y Bruce Banner (Mark Ruffalo) toma identidad propia y se convierte en el peor enemigo del planeta.

Caso Silvina Luna

Al no tener legislación, las redes sociales permiten manejarse libre y experimentalmente por fuera de los límites éticos. Por ello, el tiktoker David Hosting dejó a todos en shock cuando realizó con Inteligencia Artificial un chatbot que le permitió hablar con Silvina Luna al cumplirse un año de su fallecimiento. La conversación la inició el mismo programador con un efusivo “Hola Silvina, ¿cómo estás? Te habla David”. A lo que el programa con la voz idéntica a la de la modelo contestó: “Hola David, estoy bien, muy contenta de hablar contigo”.

Ante la pregunta de cómo se encontraba en ese otro plano, el chat emulando a Luna respondió: “Aunque ya no estoy en este plano físicamente, me siento bien y completamente libre de sufrimiento y dolor”. Ver el video genera todo tipo de sensaciones, las cuales fueron comentadas por los usuarios en las redes de Hosting. El remate de la conversación fue más intenso al preguntarle su opinión sobre Lotocki: “Aunque sentí mucha frustración y enojo… ahora no guardo ningún resentimiento hacia el doctor involucrado en mi caso de mala praxis”, respondió. Cabe destacar el que mismo usuario ya realizó el mismo procedimiento con Natacha Jaitt, Diego Maradona y con su propio hijo Brian, fallecido hace unos años.

En la actualidad, muchas son las actividades realizadas por inteligencia artificial que parecen ya normalizadas aunque presenten distintos niveles de riesgo para el usuario. Que un celular ordene fotos por reconocimiento facial no implica peligro alguno, no así un automóvil como el Tesla, el cual se maneja solo por las calles de las ciudades más cosmopolitas.

La inteligencia artificial entra en una etapa compleja y está en la ética y conciencia de sus mentores no poner a la humanidad en peligro como lo advirtió Asimov o como ya lo visualizó el cine.

Comentarios